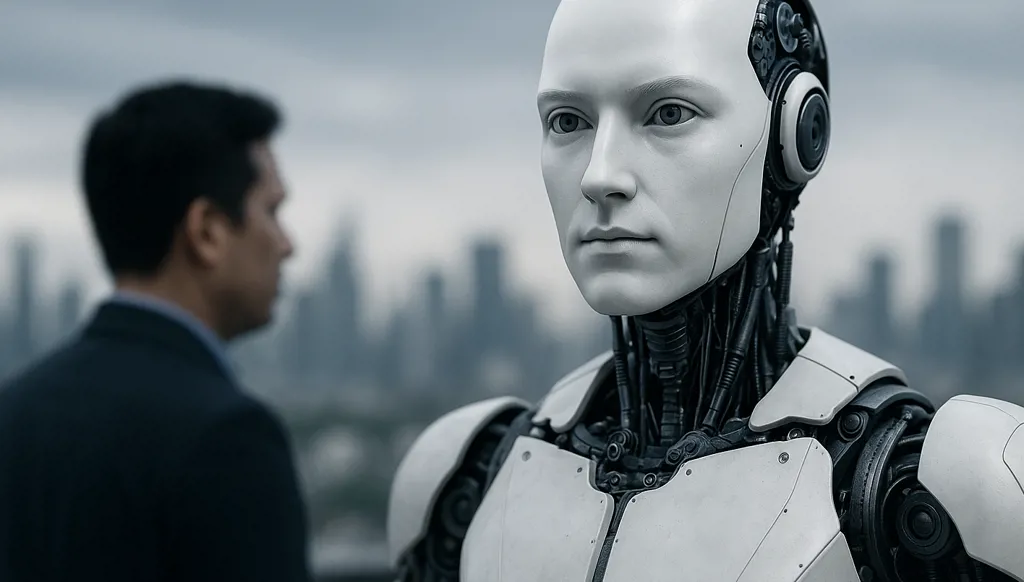

الذكاء الاصطناعي والأخلاقيات: مثلث التحديات الكبرى

بينما تُسابق الشركات الزمن لإدماج تقنيات الذكاء الاصطناعي في قطاعات التعليم والطب والإعلام، يتنامى على الجانب الآخر قلق عالمي متصاعد حول الأبعاد الأخلاقية لهذه الثورة الرقمية. فالمعادلة لم تعد مرتبطة فقط بمدى كفاءة الخوارزميات أو سرعة التطوير، بل بأسئلة أكثر حساسية: كيف تُجمع البيانات الشخصية التي تُغذّي هذه الأنظمة؟ ومن يضمن أن القرارات التي تتخذها الخوارزميات خالية من التحيّزات التي قد تكرّس الظلم بدل أن تزيله؟

وتزداد هذه المخاوف تعقيداً مع بروز تقنيات التزييف العميق (Deepfake)، التي تجعل من الصعب التمييز بين الواقع والوهم، وتهدّد الثقة في الإعلام والسياسة وحتى العلاقات الإنسانية. إننا أمام مشهد يعيد رسم علاقتنا بالحقيقة، ويضع المجتمعات أمام اختبار صعب بين الانبهار بالابتكار والخوف من تبعاته.

الخصوصية

يعتمد الذكاء الاصطناعي على كمّيات هائلة من البيانات: صور، مواقع، تفاصيل شخصية وصحية. هذا الاعتماد يفتح الباب أمام انتهاكات وتسريبات خطيرة، ويطرح أسئلة حول من يملك هذه البيانات وكيف تُستخدم. وكلما توسّع نطاق الاعتماد على هذه النظم، زادت الحاجة إلى حماية صارمة توازن بين المنفعة العامة والحقوق الفردية.

الانحياز الخوارزمي

الخوارزميات تُعيد إنتاج التحيّزات الموجودة في البيانات، ما قد يؤدي إلى قرارات غير عادلة في مجالات حيوية مثل التوظيف والتمويل والأمن. ورغم أن الهدف المعلن هو الحياد، فإن الواقع يُظهر أن الذكاء الاصطناعي قد يرسّخ الصور النمطية ويُعيد إنتاج الفوارق الاجتماعية، ما يجعل الشفافية والمساءلة شرطاً أساسياً لأي استخدام عادل.

التزييف العميق

تقنية قادرة على إنتاج صور وفيديوهات وصوتيات شبه واقعية، تُضعف الثقة في الإعلام والسياسة والعلاقات، وتفتح المجال واسعاً أمام التضليل. ومع تطوّرها السريع، لم يعد الخطر يقتصر على صناعة الأخبار الكاذبة، بل امتد إلى تهديد السمعة الشخصية وحتى الأمن القومي.

🔺 المثلث الأخلاقي

الخصوصية، الانحياز، والشفافية تشكّل أضلاع المثلث الأخلاقي للذكاء الاصطناعي. معالجتها تتطلّب:

• تشريعات تحمي البيانات وتضمن السيطرة عليها.

• رقابة مستقلة تكشف الانحياز وتحدّ من أثره.

• شفافية حقيقية حول كيفية عمل الخوارزميات ونتائجها.

نحو تكنولوجيا مسؤولة

الذكاء الاصطناعي ليس خلاصاً ولا خطراً بحد ذاته، بل يعكس كيفية إدارتنا له. فإذا وُضع ضمن إطار أخلاقي واضح، يمكن أن يعزّز الحرية والعدالة ويُحدث فارقاً إيجابياً في حياة البشر. أما إذا تُرك بلا ضوابط، فقد يتحوّل إلى مصدر هشاشة وقلق دائمين، ويُعيد تشكيل العالم بطرق غير عادلة وغير آمنة. المستقبل سيُحسم بقدرتنا على ضبط هذا المثلث الأخلاقي، لأن الرهان الحقيقي ليس على قوة الخوارزميات، بل على قوة القيم التي تحكم استخدامها.

العلامات الدالة

الأكثر قراءة

اتّسمت الحلقة الثانية من مرحلة المواجهات بأجواء حماسية، مع استمرار النجوم المدرّبين رامي صبري وداليا مبارك والشامي في اختيار الأصوات المتأهلة إلى المرحلة المقبلة.

مشهد عكس الشغف اللبناني بالحياة والفن والموسيقى، والتقاطع الثقافي بين لبنان وإيطاليا.

واتساب

واتساب

تویتر

تویتر

فيسبوك

فيسبوك

يوتيوب

يوتيوب

انستغرام

انستغرام

نبض

نبض

ثريدز

ثريدز

مسنجر

مسنجر

بريد إلكتروني

بريد إلكتروني

الطباعة

الطباعة