Hi, I'm a tech reporter that covers China, cybersecurity, & new media. Hundreds of people are sharing this photo of Xi Jinping & Vladimir Putin as they meet at the Kremlin. The two did meet, but it's highly likely this photo was generated by an AI program. Here's why: 🧵 pic.twitter.com/6xqsDLxiMa

— Amanda Florian 小爱 (@Amanda_Florian) March 21, 2023

غالباً ما يعمد صانعو هذه الصور للإشارة إلى أنّها نتاج برامج ذكاء اصطناعيّ، لكنّها سرعان ما تنتشر خارج سياقها ويصدّق البعض أنّها حقيقيّة.L'#ia #photo a fait des progrès démentiels en très peu de temps, désormais le #fake sera la norme sur les #reseaux, doutez de ce que vous voyez par défaut, plus le choix.#midjourney #midjourneyv5 pic.twitter.com/dJoZXGrbRy

— Cryptonoo₿ From 100K to 0 🐐 (@Cryptonoobzzzz) March 19, 2023

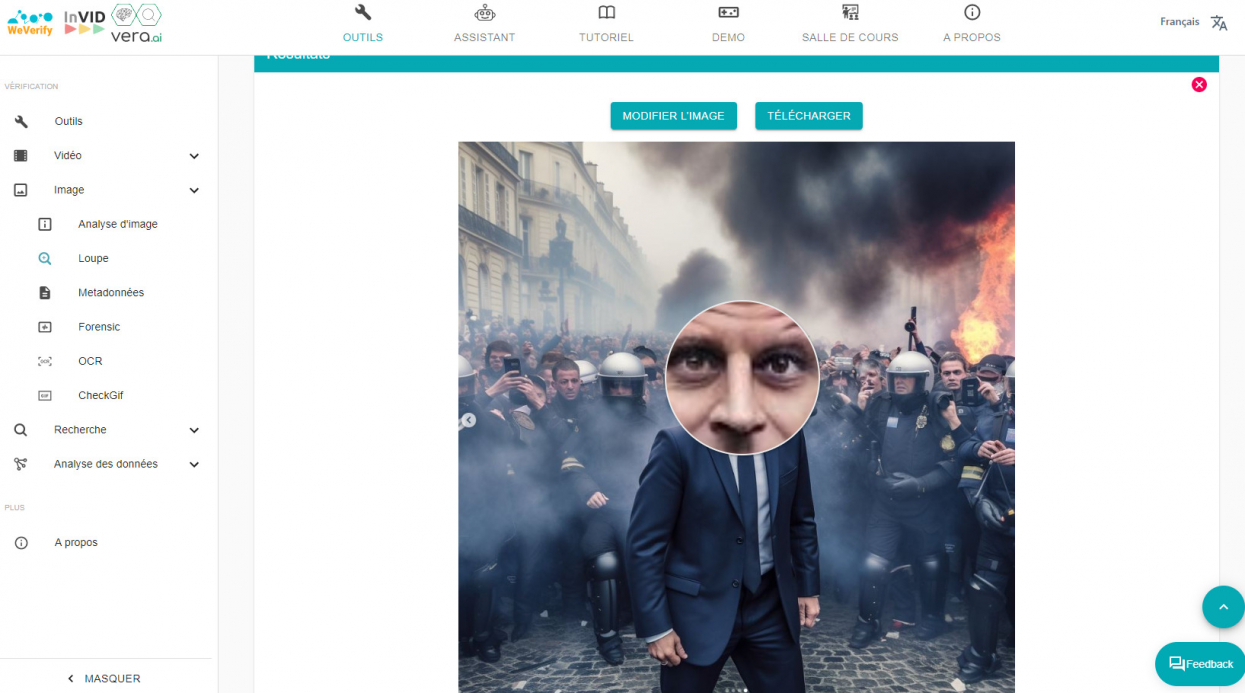

هناك أدوات عدّة لكشف حقيقة هذه الصور وأخرى قيد التطوير، إلا أنّ النتائج التي تقدّمها ليست حاسمة، وقد تعطي نتائج غير دقيقة، بحسب تجارب قام بها صحافيو فرانس برس.

ويشرح ديفيد فيشينغر المهندس المتخصّص في الذكاء الاصطناعيّ في جامعة فيينا للتكنولوجيا لفرانس برس أنّ عمل الذكاء الاصطناعي لا يقوم على مجرّد اقتطاع أجزاء من صورٍ لإعادة تركيبها إذ "يلجأ إلى ملايين بل مليارات الصور لاستخراج بيانات منها، ثمّ يعيد استخدامها لتوليد صورة جديدة تماماً".

بدوره يوضح لفرانس برس فينسنت تيراسي، أحد مؤسسي شركة Draft&Goal الناشئة التي تطوّر أداة خاصة بالجامعات تكشف المحتوى المنتج عبر الذكاء الاصطناعي، أنّ برامج الذكاء الاصطناعي تخلط الصور المتاحة لها في قاعدة البيانات ثم تفكّكها لتعيد بناء مشهد جديد تماماً لا يمكن تتبّع العناصر المستخدمة في صناعته.

لهذه الأسباب لا يمكن لمنصّات كشف الذكاء الاصطناعي أن تصل لنتائج حاسمة في هذه المرحلة.

لكن ماذا عن البيانات الوصفيّة (Metadata) التي تُعتبر بطاقة تعريفيّة للصورة ويمكن أن تتضمّن معلومات عن أصلها؟

"للأسف لا يمكن الاعتماد على هذه البيانات لأنّها تُحذف مباشرة عند تحميل الصورة على مواقع التواصل"، بهذه العبارة تجيب الأستاذة في جامعة فريديريك -2 في نابولي والمتخصصة في الذكاء الاصطناعيّ أناليزا فيردوليفا على سؤال فرانس برس.

العودة إلى مصدر الصورة

بحسب الخبراء، أفضل طريقة لكشف حقيقة الصورة تكمن في العثور على مصدرها الأصليّ، فقد تكون منشورة على حساب مَن صنعها مرفقة بإشارة إلى أنّها نتاج برنامج ذكاء اصطناعيّ.

وهنا يمكن استخدام البحث العكسيّ عن الصور في مختلف محرّكات البحث للوصول إلى الصفحات التي نشرت الصورة.

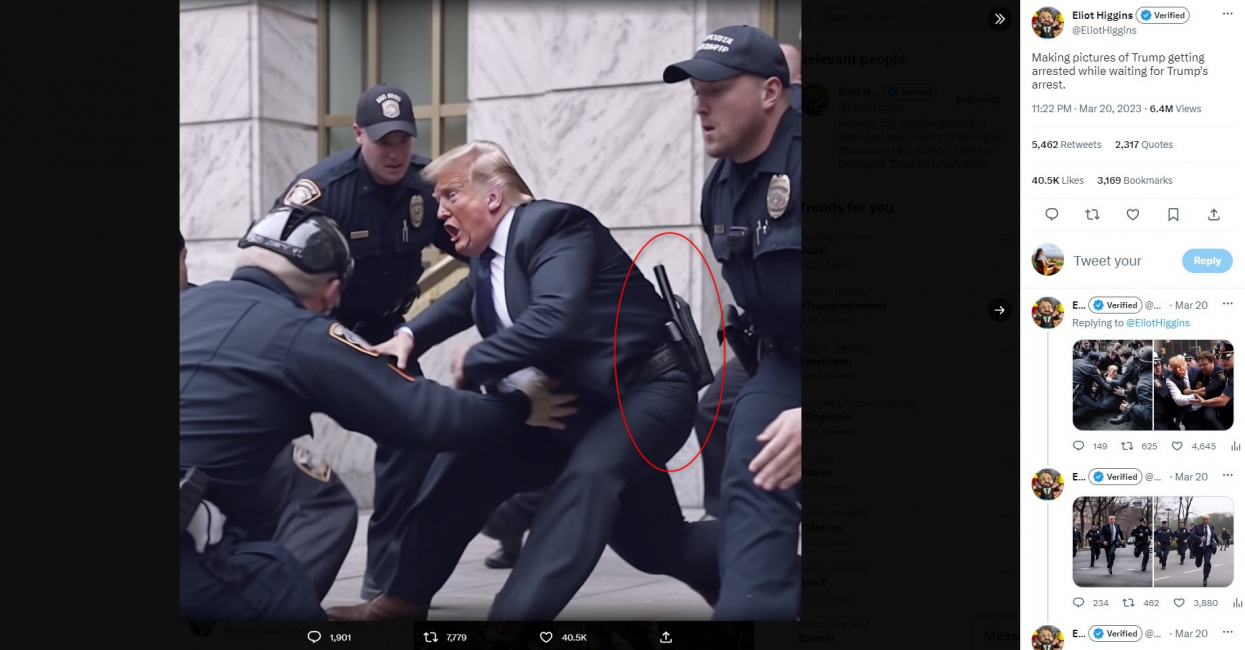

لقد أتاحت هذه الطريقة الوصول إلى أصل الصور التي زعم ناشروها أنّها لتوقيف الرئيس الأميركي السابق دونالد ترامب.

فقد أرشد أحد الروابط إلى تغريدة نشرها إليوت هيغينز مؤسس موقع بيلينغات المتخصّص بالتحقيقات المفتوحة المصدر في 20 آذار 2023، يقول فيها إنّه صَنع هذه الصور باستخدام الإصدار الأخير لبرنامج "ميدجورني".

Making pictures of Trump getting arrested while waiting for Trump's arrest. pic.twitter.com/4D2QQfUpLZ

— Eliot Higgins (@EliotHiggins) March 20, 2023

إلى ذلك يمكن أن تقدّم محرّكات البحث لقطات شبيهة، ما يفتح المجال لمقارنة الصورة موضع الشكّ بصورٍ حقيقيّة من مصادر موثوقة.

على سبيل المثال، انتشرت صورة زعم ناشروها أنّها تُظهر الرئيس الروسي فلاديمير بوتين راكعاً يقبّل يد نظيره الصينيّ خلال زيارته الأخيرة إلى موسكو، إلا أنّ الصحافيّ الإيطاليّ ديفيد بوينتي أشار في حسابه على موقع تويتر أنّ الصالة التي اجتمع فيها الرئيسان في الحقيقة مختلفة تماماً عن الخلفيّة الظاهرة في الصورة، ما يثير الشكوك حولها.

ويُتيح برنامج "ميدجورني" البحث عن الصّور التي ينتجها ضمن قنواته باستخدام كلمات مفتاح.

وإن لم يكن متاحاً الوصول إلى أصل الصور، عندها يمكن التركيز على تفاصيل داخلها.

تحليل الصورة

تعمد بعض برامج الذكاء الاصطناعي على ترك علامة على الصور التي تنتجها كالشّريط الملّون الذي يظهر على الصور المنتجة من خلال برنامج "دال-إي"، أو علامة القلم الملّون التي يتركها برنامج "كرايون"، أو علامة محرّك "بينغ".

التدقيق في نقاط الصورة (pixels)

"عند الشكّ يجب التدقيق بنقاط الصورة (pixels) فهي تختلف بين الصورة الفوتوغرافيّة وتلك المولّدة باستخدام الذكاء الاصطناعي"، بحسب تينا نيكوكا المتخصّصة في معالجة الصور في مختبر الرياضيات في جامعة باريس-ساكلي لفرانس برس.

حاول صحافيو فرانس برس توليد صورة للممثّل براد بيت في باريس باستخدام برنامج "ستايبل ديفيوجن" فبدت شبيهة بالرسم الواقعيّ.

وباستخدام التعليمات نفسها أخرج برنامج "دال-إي" صورة أقرب إلى الصور الفوتوغرافيّة.

على الرغم من التطوّرات التي شهدتها هذه البرمجيات، إلا أنّ الصور التي تنتجها لا تزال تشوبها عيوبٌ وتشوّهات. وتعدّ هذه الأخطاء السبيل الأفضل لكشف هذا النوع من الصور.

من جهتها تحذّر أناليزا فيردوليفا من أنّ برمجيات الذكاء الاصطناعي تتحسّن يوماً بعد يوم ويجب ألاّ نركن فقط إلى هذه الأخطاء التي تظهر حالياً.

كانت برمجيات الذكاء الاصطناعي، وإلى غاية آذار 2023، تنتج صوراً تشوبها أخطاء وتشوّهات على مستوى اليدين كما يظهر في هذه الصور التي تبدو شديدة الواقعيّة باستثناء يد الشرطيّ الذي يرتدي قفازاً من ستة أصابع.

The hand strikes again🖖: these photos allegedly shot at a French protest rally yesterday look almost real - if it weren't for the officer's six-fingered glove #disinformation #AI pic.twitter.com/qzi6DxMdOx

— Nina Lamparski (@ninaism) February 8, 2023

ويشير تيراسي إلى أنّ التدقيق بالعيون مفيد أيضاً في هذا الإطار، إذ إنّها تظهر انعكاساً قد تشوبه أخطاء، كما يمكن رصد اختلافٍ بالشكل أو بالحجم أو باللون بين العينين، ما يمكن أن يقدّم دليلاً إضافياً.

تشكّل النظّارات الشمسيّة تحدياً إضافياً لهذه البرمجيات، إذ تظهر أحياناً وكأنها ذائبة على وجه الأشخاص.

ويلفت الخبراء النظر إلى أنّ اعتماد برمجيات الذكاء الاصطناعي على مزج عناصر من صورٍ عدّة قد ينعكس على جودة الصورة خصوصاً على مستوى الإضاءة.

النظر إلى خلفيّة الصورة

هذه الصورة التي جابت مواقع التواصل الاجتماعي وتظهر الرئيس الأميركي باراك أوباما والمستشارة الألمانية السابقة أنجيلا ميركل على شاطئ، تبدو شديدة الواقعيّة للوهلة الأولى، إلا أنّ التدقيق في عناصرها يثبت العكس إذ يظهر أحد الواقفين مقطوع الرجلين.

ويوضح فينسنت فيراسي أنّه كلّما ابتعدت العناصر عن وسط الصورة تزيد نسبة تعرّضها لتشوّهات.

تتضمّن الصور المولّدة باستخدام الذكاء الاصطناعي عناصر قد لا تكون مشوّهة إلا أنّها تشكّل بوجودها خطأ منطقياً، لذلك يجب اتباع المنطق السليم عند التدقيق في صورة موضع شكّ.

فهذه الصورة التي صنعها صحافيّو فرانس برس عبر برنامج "ميدجورني" من المفترض أن تظهر الممثل الأميركي براد بيت يحمل الكرواسان في العاصمة الفرنسيّة باريس، إلا أنّ الإشارة المروريّة في الخلفيّة زرقاء اللون، وهذا النوع من الإشارات غير مستخدمٍ في الأصل في فرنسا.

كما أنّ الخطّ متعدّد الألوان أسفل اليمين يحسم أنّ الصورة صنيعة برنامج "دال-إي".

إلى ذلك لا يبدو الشخص الظاهر في الصور شبيهاً ببراد بيت.

في النهاية، إذا انتشرت صورٌ تزعم وقوع حدثٍ ما (لقاء سياسيّ، تظاهرة…) وهناك شكوك حولها، يبقى من الأفضل البحث في مصادر إخباريّة موثوقة عمّا إذا كان الحدث وقع فعلاً.

وإن كان الحدث قد وقع بالفعل (مثل لقاء الرئيسين الروسي والصيني) يمكن الاستناد إلى الصور الحقيقيّة ومقاطع الفيديو التي وثّقت الحدث ومقارنتها بعناصر الصور المشكوك بأمرها.

تویتر

تویتر

فيسبوك

فيسبوك

يوتيوب

يوتيوب

انستغرام

انستغرام

نبض

نبض

ثريدز

ثريدز

مسنجر

مسنجر

واتساب

واتساب

بريد إلكتروني

بريد إلكتروني

الطباعة

الطباعة